Los juristas estudian cómo regular los efectos de la sustitución de trabajadores por máquinas inteligentes

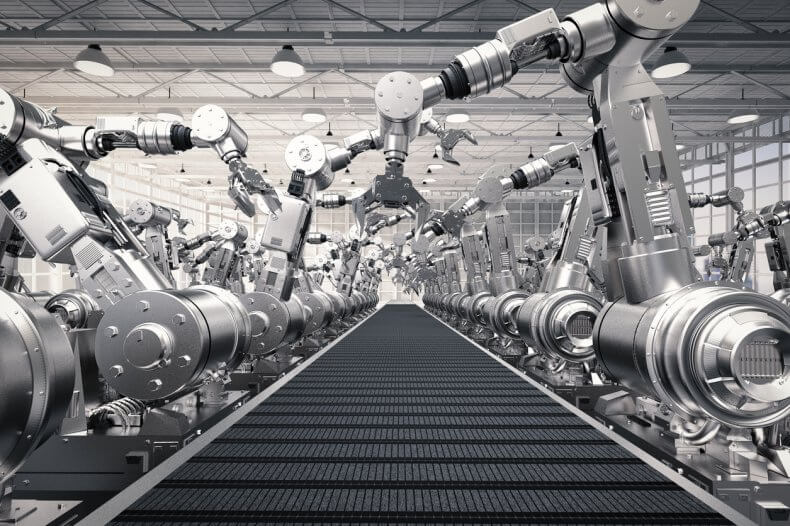

No es ciencia ficción. El desarrollo de la tecnología ha abierto el debate de cómo regular la presencia de robots en nuestra sociedad. Una materia que, hasta ahora, parecía vedada al cine o a la literatura.

El salto cualitativo que da la robótica frente a las máquinas tradicionales es su capacidad de recoger y almacenar cantidades ingentes de datos y, de acuerdo con los mismos, tomar decisiones de forma autónoma. Una realidad que plantea numerosos desafíos legales que, en muchos casos, desbordan las figuras existentes en el Derecho.

El atropello mortal que el pasado mes de marzo protagonizó un coche autónomode Uber en Tempe, en el estado de Arizona (EE UU) ha puesto de manifiesto que no se trata de una cuestión lejana. Y, aunque las instituciones nacionales e internacionales aún no han entrado a fondo en cómo legislarla, en el ámbito.i

La cuestión es especialmente sensible en relación al mercado de trabajo, en donde se prevé que la robotización ponga en peligro un gran número de empleos. Íñigo Sagardoy, presidente de Sagardoy Abogados, firma especializada en el ámbito del trabajo, señala que la robotización plantea dos desafíos al Derecho laboral. En primer lugar, la regulación de la propia presencia de los robots en el entorno productivo. Es decir, qué tareas pueden realizar, con qué límites o quién responde de los daños que puedan causar. Y, en segundo término, cómo afrontar el impacto económico de este proceso. “Si se produce una sustitución masiva de trabajadores por robots, habrá que estudiar algún tipo de compensación económica que palíe el descenso de las cotizaciones a la Seguridad Social”, reflexiona.

Para equilibrar la eventual merma de ingresos se han puesto sobre la mesa varias opciones. Una de ellas es que los robots coticen. Un mecanismo, no obstante, que tiene un encaje muy difícil con la normativa de la Seguridad Social y que choca con el propio concepto de cotización (¿qué prestación tendría a cambio el robot? ¿derecho a la reparación?).

Otra es la de gravar fiscalmente los robots. “Es un principio básico: para pagar un impuesto, tiene que haberse mostrado una capacidad económica”, explica Álvaro de la Cueva, socio de Fiscal de Garrigues. La gran cuestión en torno a los robots es cuál es esa muestra de capacidad económica. “¿Lo es el mero hecho de tenerlo o el utilizarlo de tal manera que reemplaza el uso de fuerza laboral?”, se pregunta.

¿Quién paga impuestos?

Otro de los debates que hay sobre la mesa de los fiscalistas es a quién debe considerarse como el obligado tributario, si al robot o al empresario. “La capacidad económica la tienen las personas y, de momento, los robots no son personas. Aunque existe, en el ámbito civil, quien aboga por crear una personalidad robótica, que se sumaría a la de las personas físicas y jurídicas”, reflexiona De la Cueva. Mientras esta doctrina no prospere, los expertos se inclinan por considerar que el impuesto debe recaer sobre el empresario.

La siguiente duda es cómo se articula este gravamen: como una imputación de renta, incluido en el impuesto de sociedades (IS), o como un beneficio adicional distinto. Otro de los aspectos que debe abordarse, según De la Cueva, es si dejará de considerarse al robot como una máquina que la empresa va amortizando y cuyos gastos se deduce. “Vamos a tener que darle una vuelta al IS”, vaticina el abogado, que no descarta la modificación a medio plazo de otros gravámenes.

Javier de Cendra, decano del IE Law School, se sirve del ejemplo de los coches autónomos para introducir otro de los grandes desafíos que la robotización plantea al Derecho: el impacto que las decisiones de las máquinas tendrán sobre la vida y los bienes de los humanos. “Se dará el caso de que un vehículo decida que, para preservar la vida de sus ocupantes, tiene que poner en riesgo la de los viandantes”. En consecuencia, razona, antes de que empiecen a circular, habrá que aclarar quién responde de las consecuencias negativas de su actividad. Una circunstancia que sólo será posible si puede “trazarse una relación de causalidad entre la decisión del robot de acuerdo a sus algoritmos y los responsables de las mismas”, ya sea el fabricante, el programador, el propietario o el usuario.

El problema viene cuando, a través de los mecanismos de aprendizaje de las propias máquinas, no sea posible conocer o comprender qué ha motivado su decisión. “Ahí tendremos que plantearnos los sistemas de atribución de responsabilidad actuales y si tiene sentido considerar que ese coche, en la medida en que puede asimilarse a una persona con consciencia, debe asumir las consecuencias de sus actos”, expone De Cendra.

En ese punto, el jurista se muestra partidario de crear una personalidad robótica de las entidades digitales. Así, al igual que se han ampliado las obligaciones de las personas jurídicas (que pueden, por ejemplo, ser condenadas por la comisión de delitos), ve posible que las máquinas autónomas “también puedan tener responsabilidades, incluso de tipo penal, en el caso de que tomen decisiones con consecuencias graves”. “Esto será una realidad dentro de 15 o 20 años, pero la filosofía jurídica debe hacerse estas preguntas ahora”, concluye.

Y, si tienen obligaciones, ¿podrán los robots también tener derechos, como el de sindicación? En el ámbito del trabajo, Sagardoy lo descarta. “Las relaciones laborales están basadas en una relación personalísima entre el empleado y el empresario. Quizás dentro de 200 años, en un escenario del estilo Blade Runner… pero ahora mismo no lo veo”.

Fuente: elpais.economia

Autor: Pedro del Rosal